Sowohl beim autonomen Fahren als auch in der Industrie sind Störungen aus der Umgebung, wie z. B. Hintergrundlicht, immer eine Herausforderung für LiDAR-Systeme. Für den zuverlässigen Einsatz optischer Sensoren ist es von entscheidender Bedeutung, wie Störungen durch Umweltfaktoren reduziert werden können, um die Robustheit des Systems zu verbessern und gleichzeitig die Echtzeitfähigkeit zu erhalten. In einem Forschungsprojekt entwickelt das Fraunhofer IMS einen robusten, auf maschinellem Lernen basierenden Algorithmus zur Abstandsbestimmung namens »Multi-Peak-Analyse (MPA)« für LiDAR-Histogrammdaten unter rauen Detektionsbedingungen. Unter rauen Detektionsbedingungen sind hier z. B. Umgebungen mit starkem Hintergrundlicht (hoher Hintergrundphotonenrate), Situationen mit Objekten in großer Entfernung und eine hohe geforderte Frame-Rate zu verstehen.

Eine Variante der MPA ist die auf einem neuronalen Netz basierende MPA (NNMPA), die ein sehr kompaktes Feed-Forward Neural Network verwendet ohne die Präzision der ermittelten Abstände zu beeinträchtigen. Nach einer physikalisch gesteuerten Merkmalsextraktion benötigt das neuronale Netz nur 1 % der Originaldaten für Training und Vorhersage. Für die Evaluierung der NNMPA werden 100.000 LiDAR-Histogrammdaten (sowohl synthetische als auch reale) verwendet, die auf dem vom Fraunhofer IMS entwickelten Flash-LiDAR-System »OWL« basieren.

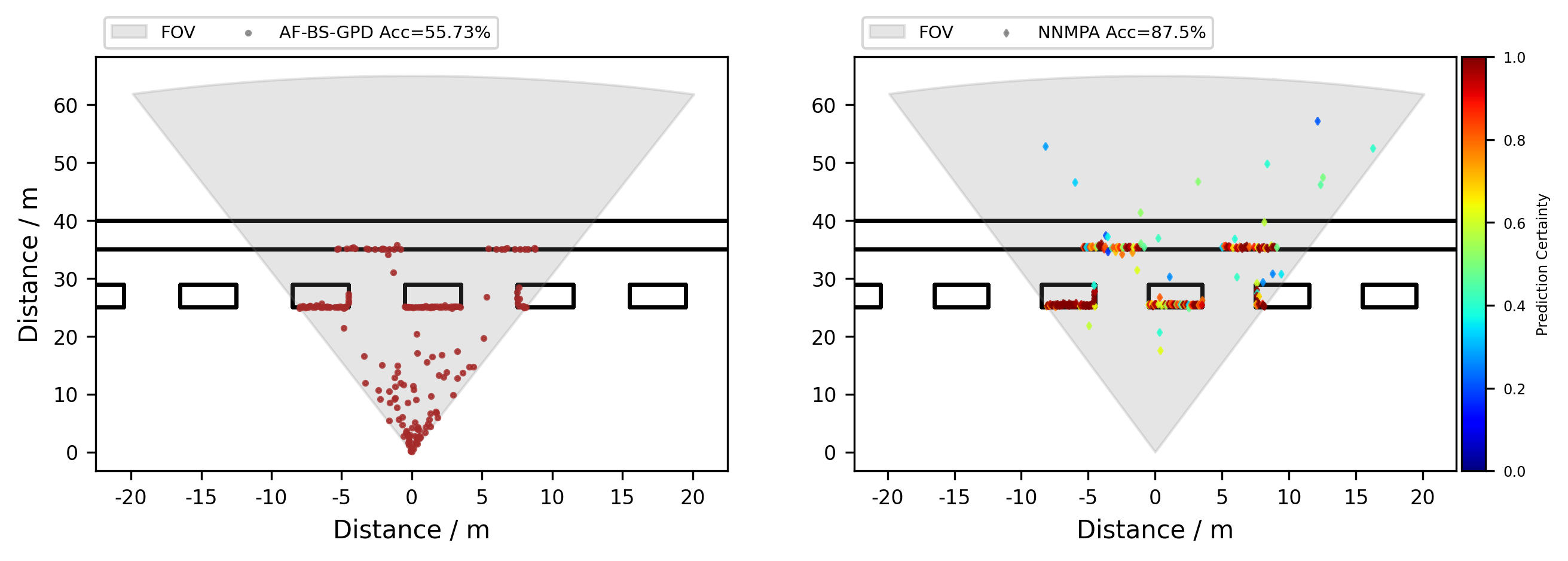

Die NNMPA wurde mit der klassischen digitalen Verarbeitung verglichen, die einen Mittelwertfilter, Hintergrundsubtraktion sowie eine globale Spitzenwertdetektion (AF-BS-GPD) umfasst, und zeigt überlegene Ergebnisse. Bei Zielabständen von 25 bis 60 m und hohem Hintergrundlichtanteil ist die Genauigkeit der Abstandsbestimmung der NNMPA beispielsweise um 26% höher als die von der AF-BS-GPD. Ein Beispiel ist in Abbildung 1 zu sehen. In diesem speziellen Szenario wird die AF-BS-GPD stark vom Hintergrundlicht gestört (linkes Diagramm). Dies führt dazu, dass fast die Hälfte der Abstandsbestimmungen falsch sind. Die gemessenen Entfernungen sollen deutlich geringer sein, als sie es tatsächlich sind (Häufung der »roten Punkte« im unteren Bereich). Die NNMPA (rechtes Diagramm) erreicht dagegen eine gesamte Genauigkeit von fast 88 %. Außerdem liefert die NNMPA zusätzlich die Information der Messgüte, die im rechten Diagramm durch die Farbe dargestellt wird. Weiterhin ist dem rechten Diagramm zu entnehmen, dass die falschen Bestimmungsergebnisse eine relativ niedrige Messgüte aufweisen. Diese Information ist besonders nützlich für eine anschließende Weiterverarbeitung und Entscheidungsfindung.